Bạn đã bao giờ đối mặt với tình trạng website đột ngột chậm đi, thậm chí không thể truy cập được? Một trong những nguyên nhân phổ biến là do máy chủ phải xử lý một lượng yêu cầu (request) quá lớn trong cùng một thời điểm, dẫn đến quá tải và sập hệ thống. Tình trạng này không chỉ đến từ các cuộc tấn công có chủ đích như DDoS là gì mà còn có thể do các bot tự động hoặc lỗi từ phía client gửi yêu cầu liên tục. Vấn đề cốt lõi nằm ở chỗ máy chủ dễ bị tổn thương khi có một lượng truy cập khổng lồ từ một hoặc nhiều nguồn đổ về. Để giải quyết triệt để, việc áp dụng cơ chế giới hạn tốc độ (rate limiting) trên Nginx là một giải pháp cực kỳ hiệu quả. Đây là cách bạn kiểm soát và phân phối lưu lượng truy cập một cách thông minh, đảm bảo máy chủ luôn hoạt động ổn định. Trong bài viết này, chúng ta sẽ cùng nhau tìm hiểu từ khái niệm, lợi ích, cách cấu hình chi tiết cho đến các mẹo tối ưu khi sử dụng rate limiting trên Nginx.

Rate Limiting là gì và lợi ích khi sử dụng trên Nginx

Giới thiệu về rate limiting trong Nginx

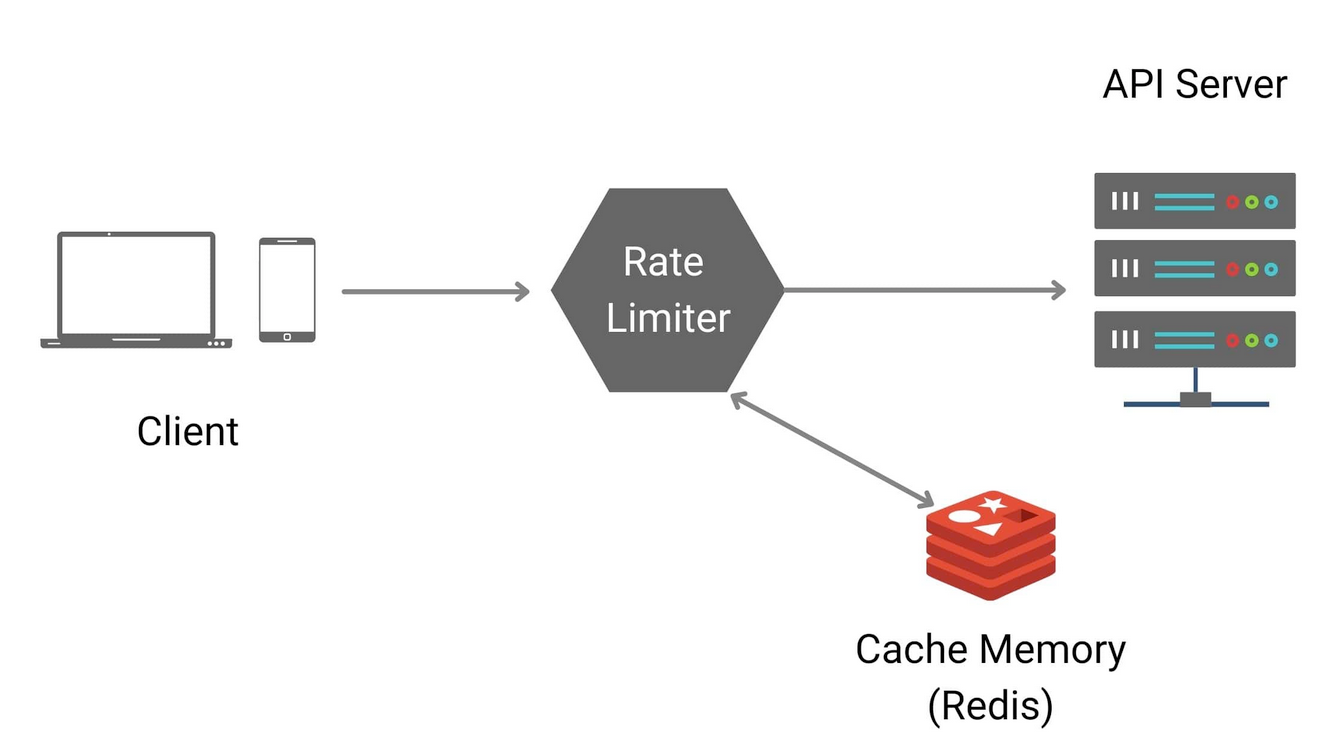

Rate limiting là một kỹ thuật được sử dụng để kiểm soát số lượng yêu cầu mà một người dùng hoặc một địa chỉ IP có thể thực hiện trong một khoảng thời gian nhất định. Hãy tưởng tượng máy chủ của bạn như một cửa hàng và rate limiting là người bảo vệ ở cửa. Người bảo vệ này sẽ đảm bảo rằng mỗi khách hàng chỉ vào cửa hàng với một tần suất hợp lý, tránh tình trạng chen lấn gây hỗn loạn bên trong. Trong Nginx, cơ chế này hoạt động dựa trên thuật toán “Leaky Bucket” (Thùng rò rỉ). Tất cả các yêu cầu đến sẽ được đưa vào một “thùng” có kích thước nhất định. Các yêu cầu này sẽ được xử lý theo một tốc độ đã được định sẵn, giống như nước rò rỉ ra khỏi thùng. Nếu yêu cầu đến quá nhanh làm thùng bị đầy, các yêu cầu mới sẽ bị từ chối hoặc trì hoãn. Nginx cung cấp hai chỉ thị (directive) chính để thực hiện việc này: limit_req dùng để giới hạn tốc độ yêu cầu (ví dụ: 5 yêu cầu/giây) và limit_conn dùng để giới hạn số lượng kết nối đồng thời từ một địa chỉ IP. Đây là một phần trong hệ thống bảo mật dịch vụ, liên quan mật thiết đến các công cụ như Firewall là gì và Ips là gì.

Lợi ích của việc áp dụng rate limiting

Việc áp dụng rate limiting trên Nginx không chỉ là một biện pháp kỹ thuật mà còn là một chiến lược quan trọng để bảo vệ và tối ưu hóa hạ tầng của bạn. Lợi ích rõ ràng nhất là giữ cho hiệu suất máy chủ luôn ổn định. Bằng cách ngăn chặn các client gửi yêu cầu với tốc độ quá cao, bạn đảm bảo rằng tài nguyên CPU và bộ nhớ không bị cạn kiệt, giúp máy chủ luôn có đủ sức để phục vụ những người dùng hợp lệ. Thứ hai, rate limiting giúp ngăn chặn tình trạng quá tải do các yêu cầu không hợp lệ, chẳng hạn như bot quét web, script tự động hoặc các client bị cấu hình lỗi. Điều này giúp giảm thiểu lãng phí tài nguyên cho những truy cập vô ích. Quan trọng hơn cả, đây là một trong những tuyến phòng thủ đầu tiên và hiệu quả nhất để chống lại các cuộc tấn công từ chối dịch vụ (DDoS) và tấn công dò mật khẩu (brute force). Khi một kẻ tấn công cố gắng làm sập máy chủ bằng cách gửi hàng ngàn yêu cầu mỗi giây, Nginx sẽ tự động chặn hoặc làm chậm các yêu cầu này ngay từ lớp ngoài, bảo vệ ứng dụng của bạn an toàn.

Hướng dẫn cấu hình rate limiting trên Nginx

Thiết lập khu vực lưu trữ (zones) để kiểm soát giới hạn

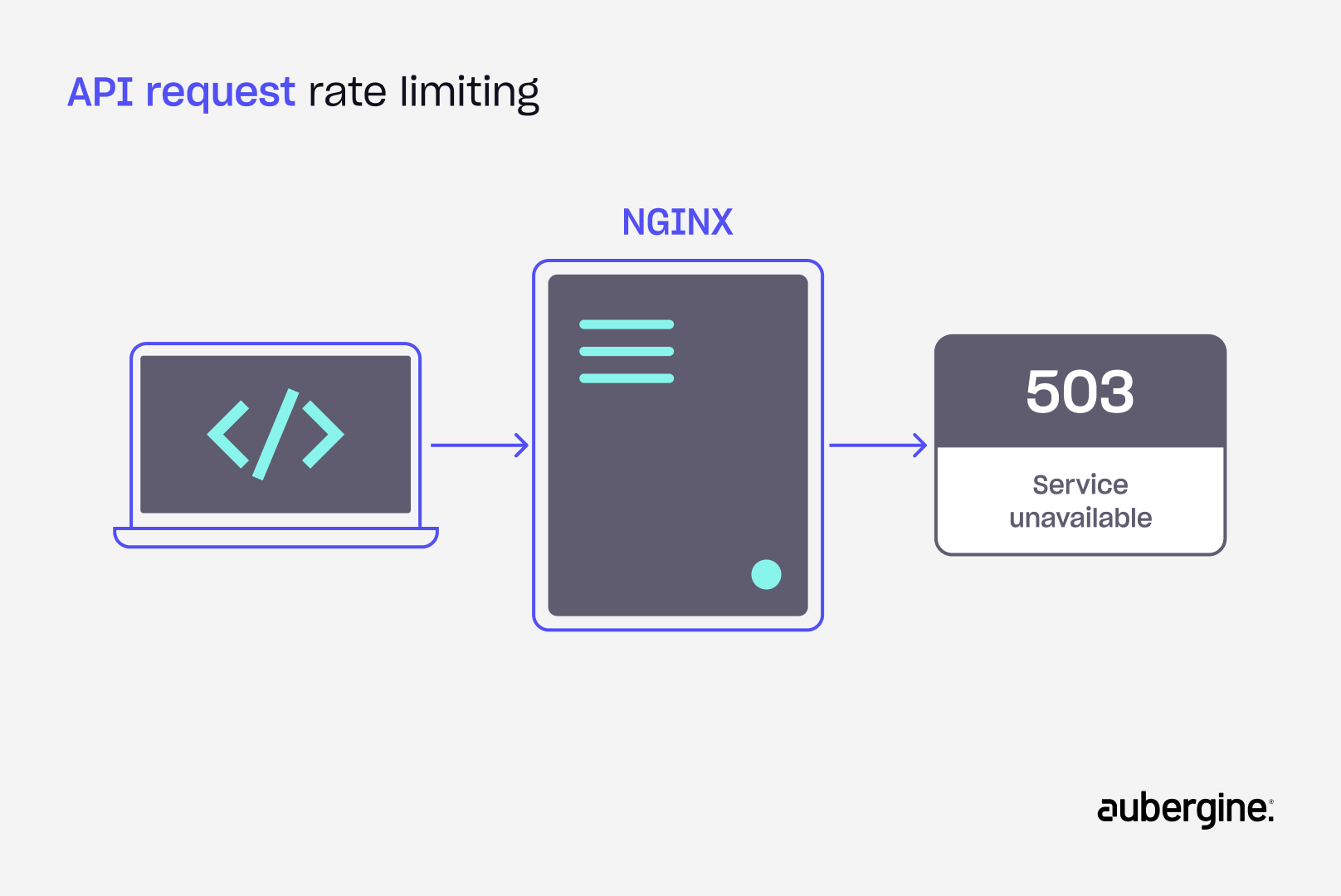

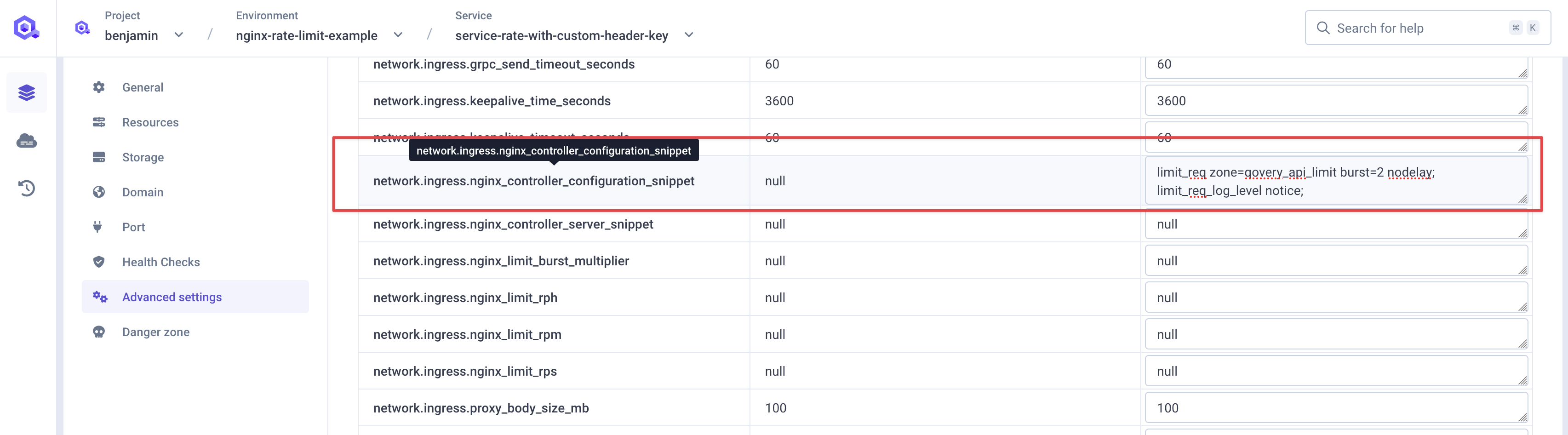

Để bắt đầu cấu hình rate limiting, bước đầu tiên và quan trọng nhất là phải định nghĩa một “khu vực bộ nhớ chia sẻ” (shared memory zone). Khu vực này sẽ được Nginx sử dụng để lưu trữ trạng thái của các yêu cầu đến từ mỗi địa chỉ IP, chẳng hạn như lần cuối họ truy cập là khi nào và đã có bao nhiêu yêu cầu. Việc này được thực hiện bằng cách sử dụng chỉ thị limit_req_zone trong file cấu hình chính nginx.conf, thường đặt trong khối http. Cú pháp cơ bản của chỉ thị này như sau: limit_req_zone $binary_remote_addr zone=myzone:10m rate=1r/s;. Hãy cùng phân tích từng thành phần: $binary_remote_addr là biến chứa địa chỉ IP của client ở định dạng nhị phân, giúp tiết kiệm bộ nhớ. zone=myzone:10m tạo ra một vùng nhớ tên là myzone với dung lượng 10MB. 1MB có thể lưu trữ khoảng 16,000 trạng thái IP, vì vậy 10MB là đủ cho hầu hết các website vừa và nhỏ. Cuối cùng, rate=1r/s thiết lập tốc độ giới hạn, trong ví dụ này là 1 yêu cầu mỗi giây. Bạn cần đặt khai báo này trong khối http để nó có hiệu lực trên toàn bộ server.

Cách giới hạn số lượng yêu cầu HTTP từ một địa chỉ IP

Sau khi đã khai báo limit_req_zone trong khối http, bước tiếp theo là áp dụng vùng nhớ này vào mộtบริ cảnh cụ thể như server hoặc location. Đây là lúc bạn sử dụng chỉ thị limit_req. Chỉ thị này sẽ kích hoạt cơ chế giới hạn tốc độ cho tất cả các yêu cầu đi qua khối mà nó được đặt. Ví dụ, để áp dụng giới hạn cho toàn bộ website, bạn có thể đặt nó trong khối server: limit_req zone=myzone;. Tuy nhiên, một cấu hình thực tế thường linh hoạt hơn bằng cách sử dụng các tham số bổ sung như burst và nodelay. Tham số burst cho phép client vượt quá giới hạn một chút trong một thời gian ngắn. Ví dụ: limit_req zone=myzone burst=5;. Với cấu hình này, Nginx sẽ cho phép client gửi thêm 5 yêu cầu nữa sau khi đã đạt ngưỡng 1 yêu cầu/giây. Các yêu cầu vượt ngưỡng này sẽ được đưa vào hàng đợi và xử lý từ từ. Nếu bạn muốn các yêu cầu trong burst được xử lý ngay lập tức thay vì bị trì hoãn, hãy thêm tham số nodelay: limit_req zone=myzone burst=5 nodelay;. Cấu hình này rất hữu ích cho các trang đăng nhập hoặc API, nơi người dùng hợp lệ có thể thực hiện nhiều hành động nhanh chóng.

Ứng dụng rate limiting trong phòng chống tấn công DDoS

Cách Nginx sử dụng rate limiting để giảm thiểu DDoS

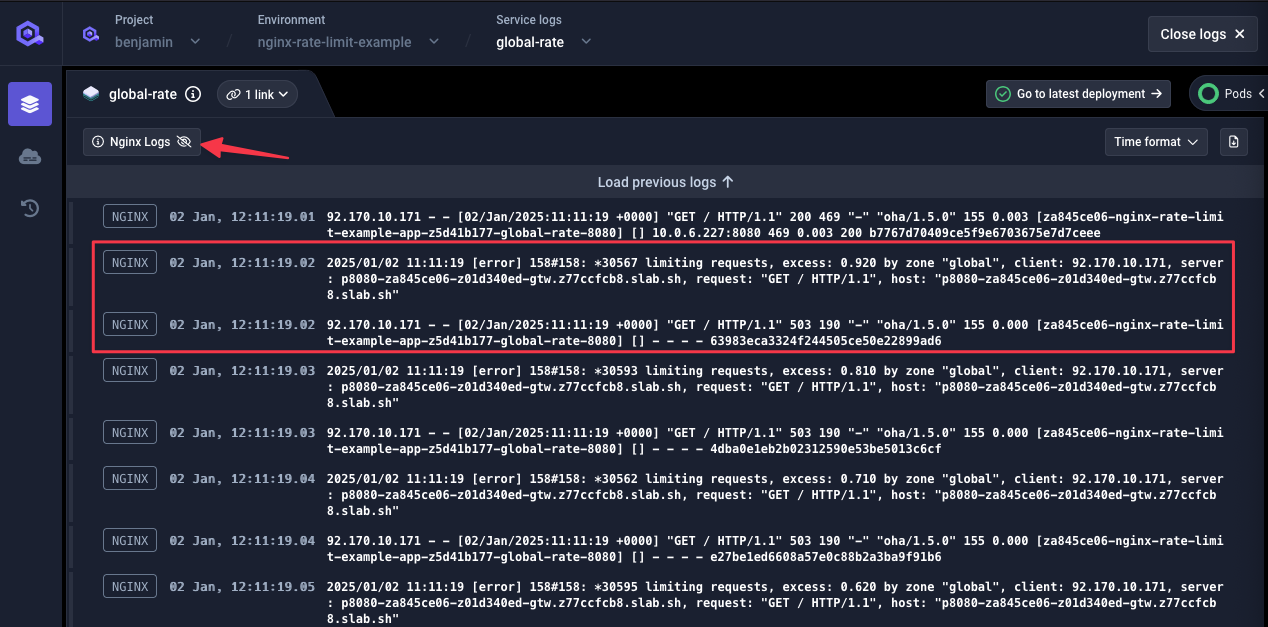

Các cuộc tấn công từ chối dịch vụ phân tán (DDoS là gì) hoạt động bằng cách làm ngập lụt máy chủ của bạn với một lượng lớn các yêu cầu vô nghĩa, khiến máy chủ cạn kiệt tài nguyên và không thể phục vụ người dùng hợp lệ. Rate limiting trên Nginx là một lớp phòng thủ cực kỳ hiệu quả ở tầng ứng dụng (Layer 7) để chống lại các cuộc tấn công này. Nguyên lý hoạt động rất đơn giản: khi một địa chỉ IP của kẻ tấn công bắt đầu gửi yêu cầu với tần suất cao bất thường, nó sẽ nhanh chóng chạm đến ngưỡng giới hạn mà bạn đã cấu hình trong limit_req_zone. Ngay lập tức, Nginx sẽ bắt đầu hành động. Tùy thuộc vào cấu hình của bạn, Nginx có thể trả về lỗi 503 Service Temporarily Unavailable cho các yêu cầu vượt ngưỡng, hoặc đưa chúng vào hàng đợi nếu có sử dụng burst. Bằng cách này, các yêu cầu độc hại bị chặn lại ngay tại cổng, không thể tiếp cận và làm quá tải ứng dụng web hay cơ sở dữ liệu phía sau. Mặc dù rate limiting không thể ngăn chặn hoàn toàn các cuộc tấn công DDoS quy mô lớn ở tầng mạng, nó là một công cụ tuyệt vời để giảm thiểu tác động của các cuộc tấn công volumetric và các loại botnet là gì đơn giản. Để tăng cường hiệu quả, bạn nên phối hợp rate limiting với các công cụ bảo mật khác như firewall (tường lửa) để tự động chặn các IP vi phạm trong một khoảng thời gian dài hơn.

Những tình huống thực tế và ví dụ triển khai

Hãy xem xét một kịch bản thực tế: trang đăng nhập /wp-login.php trên website WordPress của bạn đang bị tấn công brute force. Kẻ tấn công sử dụng một script tự động để thử hàng trăm mật khẩu mỗi phút từ cùng một địa chỉ IP. Điều này không chỉ gây rủi ro bảo mật mà còn làm tăng tải cho máy chủ. Đây là lúc rate limiting phát huy tác dụng. Bạn có thể tạo một cấu hình Nginx riêng cho location này. Đầu tiên, khai báo một zone mới trong khối http: limit_req_zone $binary_remote_addr zone=loginzone:10m rate=10r/m;. Zone này có tên loginzone, giới hạn 10 yêu cầu mỗi phút. Sau đó, áp dụng nó vào location cụ thể:

location = /wp-login.php {

limit_req zone=loginzone burst=5 nodelay;

# Các cấu hình khác cho PHP

}

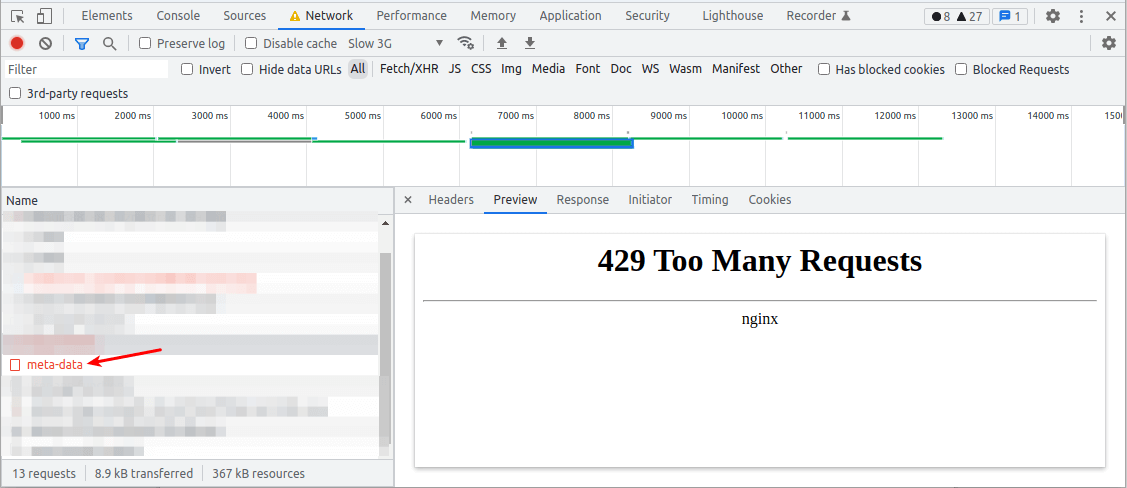

Với cấu hình này, mỗi IP chỉ có thể thử đăng nhập 10 lần mỗi phút, và có thể có 5 yêu cầu “burst” được xử lý ngay lập tức. Bất kỳ yêu cầu nào vượt quá ngưỡng này sẽ bị từ chối, làm cho cuộc tấn công brute force trở nên vô hiệu. Để phát hiện các dấu hiệu tấn công, bạn nên thường xuyên theo dõi file log lỗi (error.log) của Nginx. Khi rate limiting được kích hoạt, bạn sẽ thấy các dòng log tương tự như: limiting requests, excess: X.XXX by zone "loginzone". Việc phân tích log giúp bạn xác định các IP tấn công và điều chỉnh cấu hình giới hạn cho phù hợp hơn.

Kiểm tra và giám sát hiệu quả của cấu hình giới hạn tốc độ

Các công cụ và lệnh kiểm tra cấu hình trên Nginx

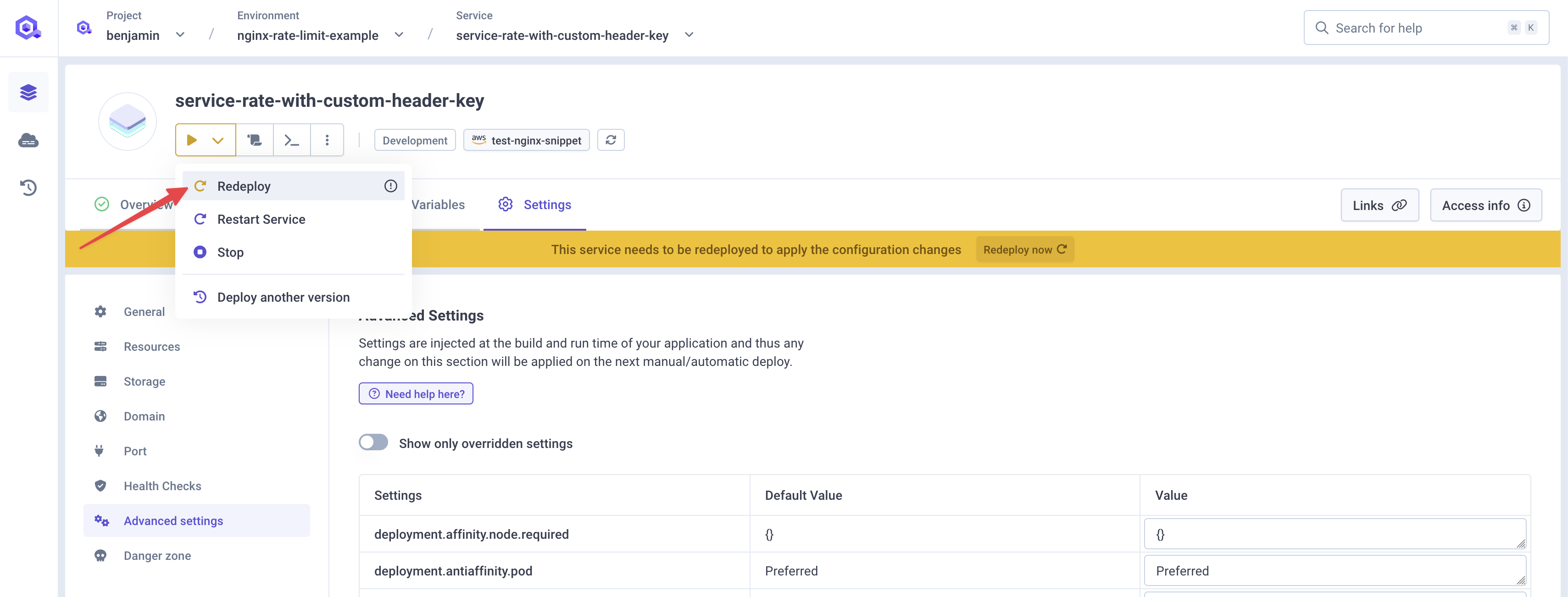

Sau khi đã chỉnh sửa file cấu hình, một bước cực kỳ quan trọng là phải kiểm tra xem cú pháp có đúng hay không trước khi áp dụng. Một lỗi nhỏ cũng có thể khiến toàn bộ dịch vụ Nginx không thể khởi động lại. Hãy luôn sử dụng lệnh nginx -t. Lệnh này sẽ quét qua tất cả các file cấu hình của bạn và báo cáo bất kỳ lỗi cú pháp nào. Nếu kết quả trả về là syntax is ok và test is successful, bạn có thể tự tin áp dụng thay đổi. Để áp dụng cấu hình mới mà không làm gián đoạn dịch vụ, hãy sử dụng lệnh sudo systemctl reload nginx hoặc sudo nginx -s reload. Lệnh này sẽ tải lại cấu hình một cách mượt mà. Sau khi đã áp dụng, cách tốt nhất để đánh giá hiệu quả là xem log. Kiểm tra file access.log để xem lưu lượng truy cập và file error.log để tìm các thông báo liên quan đến việc giới hạn yêu cầu. Các thông báo như limiting requests là bằng chứng cho thấy cấu hình của bạn đang hoạt động và đã chặn các yêu cầu vượt ngưỡng.

Giám sát thực tế qua số liệu và traffic

Kiểm tra cấu hình chỉ là bước đầu. Để thực sự hiểu được hiệu quả của rate limiting, bạn cần phải giám sát các chỉ số của máy chủ và lưu lượng truy cập một cách liên tục. Hãy theo dõi các chỉ số quan trọng như tải CPU, sử dụng bộ nhớ và số lượng kết nối đang hoạt động. Nếu cấu hình rate limiting của bạn hiệu quả trong việc ngăn chặn các cuộc tấn công hoặc truy cập bất thường, bạn sẽ thấy các chỉ số này ổn định hơn, đặc biệt là trong các đợt cao điểm traffic. Một chỉ số quan trọng khác cần theo dõi là số lượng lỗi HTTP 503 Service Temporarily Unavailable. Đây là mã lỗi mà Nginx mặc định trả về khi một yêu cầu bị giới hạn. Sự gia tăng đột ngột của lỗi này có thể cho thấy một cuộc tấn công đang diễn ra, hoặc cấu hình của bạn đang quá chặt chẽ. Dựa trên những dữ liệu giám sát này, bạn có thể đưa ra quyết định điều chỉnh cấu hình. Ví dụ, nếu bạn thấy nhiều người dùng hợp lệ bị chặn, bạn có thể cần tăng giá trị rate hoặc burst. Ngược lại, nếu máy chủ vẫn bị quá tải, bạn có thể cần siết chặt các giới hạn hơn.

Các vấn đề thường gặp và cách khắc phục

Lỗi cấu hình khiến giới hạn không hoạt động

Một trong những vấn đề phổ biến nhất mà người mới bắt đầu gặp phải là cấu hình giới hạn tốc độ nhưng nó lại không hoạt động như mong đợi. Nguyên nhân thường gặp nhất là quên khai báo limit_req_zone trong khối http. Hãy nhớ rằng, limit_req_zone phải được đặt ở cấp cao hơn (http block) so với nơi bạn áp dụng limit_req (server hoặc location block). Một lỗi khác là sai cú pháp. Ví dụ, viết sai tên zone trong chỉ thị limit_req so với tên đã khai báo trong limit_req_zone, hoặc thiếu dấu chấm phẩy ở cuối dòng. Để debug, hãy luôn bắt đầu với lệnh nginx -t. Nó sẽ chỉ ra chính xác dòng và file gây ra lỗi cú pháp. Nếu cú pháp đúng nhưng vẫn không hoạt động, hãy kiểm tra lại logic áp dụng. Có thể bạn đã đặt limit_req trong một location không khớp với URL mà bạn muốn giới hạn. Sử dụng curl -I yourdomain.com/path để kiểm tra header trả về; nếu bạn thấy lỗi 503, có nghĩa là giới hạn đang hoạt động.

Giới hạn quá chặt gây ảnh hưởng người dùng hợp pháp

Mục tiêu của rate limiting là chặn lưu lượng xấu, không phải cản trở người dùng tốt. Tuy nhiên, nếu bạn đặt giới hạn quá chặt, bạn có thể vô tình làm ảnh hưởng đến trải nghiệm của người dùng hợp lệ. Ví dụ, giới hạn 1 yêu cầu mỗi giây trên toàn bộ website có thể là quá thấp, đặc biệt với các trang web hiện đại sử dụng nhiều yêu cầu AJAX để tải nội dung. Người dùng có thể thấy trang web tải chậm hoặc một số chức năng không hoạt động. Để khắc phục, điều quan trọng là phải phân tích lưu lượng truy cập thực tế trước khi đặt ra giới hạn. Xem lại access.log để hiểu được tần suất yêu cầu trung bình của một người dùng bình thường. Sau đó, đặt ra một giới hạn hợp lý, có thể cao hơn mức trung bình một chút. Đây là lúc tham số burst trở nên cực kỳ hữu ích. Nó cho phép một người dùng tạo ra một loạt yêu cầu trong thời gian ngắn (ví dụ khi tải trang lần đầu), mà không bị chặn ngay lập tức. Việc sử dụng burst kết hợp với nodelay một cách khôn ngoan sẽ giúp cân bằng giữa việc bảo vệ máy chủ và đảm bảo trải nghiệm người dùng mượt mà.

Mẹo và lưu ý khi sử dụng giới hạn tốc độ trên Nginx

Để triển khai rate limiting một cách hiệu quả và an toàn, hãy ghi nhớ những mẹo và lưu ý quan trọng sau đây:

- Luôn kiểm thử trên môi trường Staging: Trước khi áp dụng bất kỳ thay đổi nào lên máy chủ production, hãy thử nghiệm nó trên một môi trường staging. Điều này giúp bạn phát hiện các lỗi cấu hình và đánh giá tác động của giới hạn mà không ảnh hưởng đến người dùng thật.

- Khai báo dung lượng Zone đủ lớn: Kích thước của

limit_req_zonerất quan trọng. Nếu vùng nhớ này bị đầy, Nginx sẽ bắt đầu trả về lỗi503cho tất cả các yêu cầu mới, kể cả những yêu cầu hợp lệ. Hãy tính toán dung lượng cần thiết dựa trên lượng truy cập của bạn (1MB lưu được khoảng 16,000 IP). - Kết hợp với các biện pháp bảo vệ khác: Rate limiting hoạt động tốt nhất khi được kết hợp thành một hệ thống phòng thủ nhiều lớp. Hãy sử dụng nó cùng với caching để giảm tải cho backend, và tích hợp với các công cụ như Fail2ban để tự động chặn các IP vi phạm ở cấp độ tường lửa.

- Tránh đặt giới hạn quá thấp: Một giới hạn quá nghiêm ngặt có thể làm hỏng trải nghiệm người dùng, đặc biệt là với các ứng dụng web động (Single Page Applications) vốn thực hiện nhiều yêu cầu API trong nền. Hãy phân tích kỹ lưỡng trước khi quyết định một con số cụ thể.

- Theo dõi log định kỳ: Thế giới web luôn thay đổi. Lưu lượng truy cập của bạn hôm nay có thể khác xa so với tháng sau. Hãy tạo thói quen kiểm tra log của Nginx định kỳ để theo dõi hiệu quả của cấu hình và điều chỉnh các giới hạn cho phù hợp với tình hình thực tế.

Kết luận

Qua bài viết này, chúng ta đã cùng nhau khám phá một trong những tính năng mạnh mẽ nhất của Nginx: giới hạn tốc độ (rate limiting). Đây không chỉ là một công cụ kỹ thuật đơn thuần, mà là một lá chắn vững chắc giúp bảo vệ máy chủ của bạn khỏi tình trạng quá tải, ngăn chặn các cuộc tấn công DDoS ở tầng ứng dụng và đảm bảo hiệu suất hoạt động luôn ổn định. Việc cấu hình rate limiting đúng cách giúp bạn kiểm soát dòng chảy lưu lượng truy cập, ưu tiên tài nguyên cho những người dùng hợp lệ và loại bỏ các truy cập độc hại một cách tự động. Chúng tôi khuyến khích bạn hãy bắt tay vào thực hành ngay theo những hướng dẫn chi tiết trong bài viết. Hãy bắt đầu bằng việc áp dụng các giới hạn cơ bản, sau đó theo dõi và tinh chỉnh chúng dựa trên dữ liệu thực tế từ hệ thống của bạn. Việc chủ động bảo vệ máy chủ không bao giờ là thừa. Bước tiếp theo trên hành trình của bạn có thể là tìm hiểu sâu hơn về các module bảo mật khác của Nginx, tối ưu hóa hiệu năng caching, hoặc triển khai một Web Application Firewall (WAF) để có một hệ thống phòng thủ toàn diện hơn.